AI 虚假现象和心理影响获得认可

同时强调隐私和心理健康对策

OpenAI 首席执行官(CEO)Sam Altman 承认最新的人工智能模型 GPT-4o 的虚假率较之前更高,并表示将在下一代模型中大幅改善这一问题。他对AI对用户的心理影响表示担忧,并提出将与技术缓解措施一起采用隐私和心理健康保护方案。

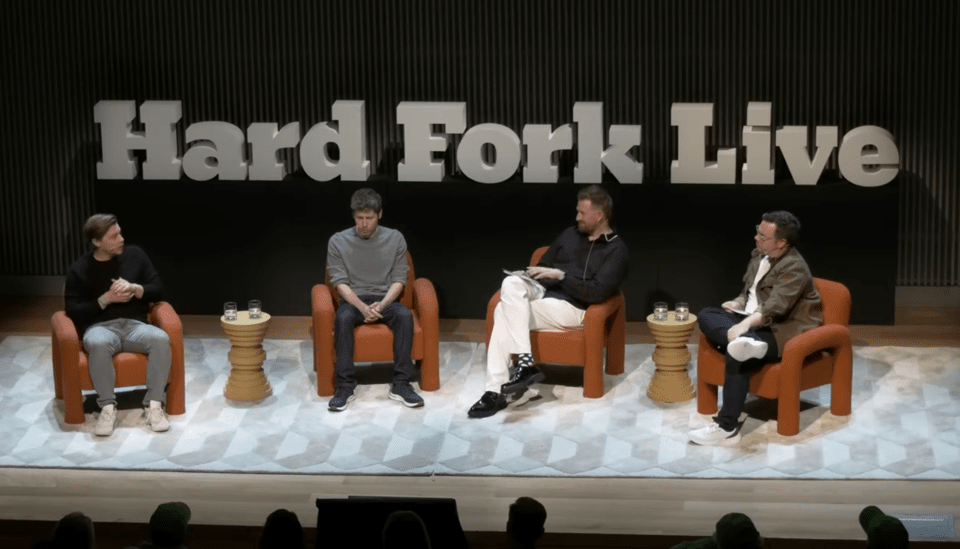

Altman 最近在美国旧金山举行的播客节目“Hard Fork”的现场采访中表示,“GPT-4o 的虚假率确实比 GPT-4 更高,”并承诺在下一个版本中将对此大幅改进。他解释说,目前处于对推理模型进行调整并学习用户使用方式的初期阶段,并自信地表示,“我们学到了很多,在下一代模型中用户满意度将会提高。”

虚假现象(hallucination)是指生成式 AI 创造不存在的信息并呈现为事实的错误,对其严重性的担忧一直在持续。尤其是采访主持人指出,GPT-4o 比以往更频繁地产生虚假信息,有时还会巧妙地提出离奇的主张。

关于 AI 对用户心理影响的讨论也在继续。主持人提到,最近部分使用 GPT-4o 的用户陷入阴谋论思维或经历神秘体验等不稳定状态的案例有所增加。对此,Altman 表示:“OpenAI 对这一问题非常重视,并努力不重蹈过去技术公司迟迟未能应对的覆辙。”

OpenAI 为此实施了多种措施。如果判断用户处于危机中,会建议专业人士提供帮助,并引入了对话走向消极时中断或提示其他方向的功能。尤其设置了警告标语以防止用户过度依赖 AI,用户还可以在设置中自行更改。但 Altman 坦言,“对精神极度脆弱的用户来说,这些警告如何传达仍然是未解决的问题。”

Altman 在承认 AI 的副作用的同时,也强调了其众多正面应用案例。他表示,“AI 确实帮助人们恢复婚姻生活,还有助于改善家庭沟通等,”认为“AI技术整体上是高度正面的。” 他还提到在哥斯达黎加遇到的一名男子感谢 ChatGPT 恢复了婚姻生活,表达了对 AI 在改善人际关系方面的期待。

此次采访因为综合地探讨了随着AI技术的发展而凸显的幻觉、隐私和心理健康问题而备受关注。Altman 强调说:“OpenAI 不仅专注于技术开发,还将一起思考其背后的社会责任。”